Apple se ha unido recientemente a 15 empresas líderes de inteligencia artificial de EE. UU. para adherirse a un conjunto de pautas voluntarias de seguridad de inteligencia artificial introducidas por la administración Biden. Estas directrices, derivadas de una orden ejecutiva emitida hace nueve meses, representan un paso importante para garantizar una innovación responsable en IA.

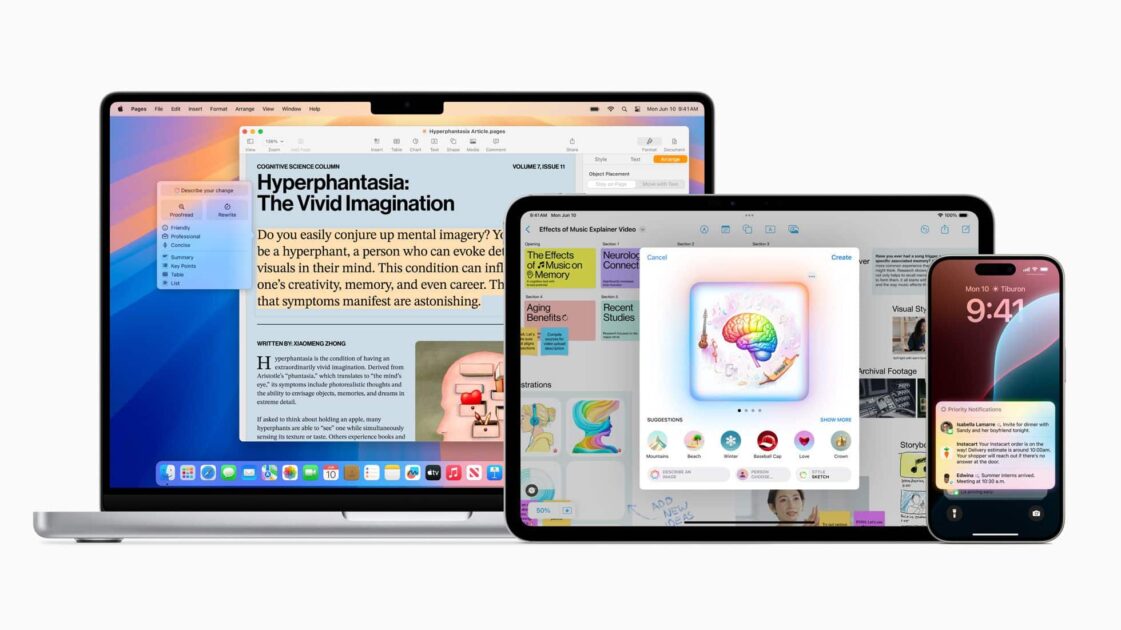

Apple anunció recientemente su conjunto de tecnologías de inteligencia artificial bajo la marca "Apple Intelligence". Esta iniciativa incluye una variedad de funciones como integración ChatGPT, creación de arte y servicios de transcripción, todo listo para lanzarse con iOS 18. Apple Intelligence es compatible con los modelos de iPhone 15 Pro y Mac equipados con chips de silicio Apple de la serie M.

Las directrices de seguridad de la IA de la administración Biden exigen que las empresas realicen pruebas rigurosas de sus sistemas de IA para detectar y mitigar sesgos discriminatorios y vulnerabilidades de seguridad. Esto incluye compartir los resultados de las pruebas con el gobierno, la sociedad civil y las instituciones académicas, fomentando así una cultura de revisión por pares y rendición de cuentas. Si bien estas directrices no son legalmente vinculantes, marcan un esfuerzo crucial por parte de la industria tecnológica para autorregularse y abordar los riesgos potenciales asociados con las tecnologías de IA.

La participación de Apple en esta iniciativa es oportuna, coincidiendo con el inminente lanzamiento de las funciones Apple Intelligence en iOS 18, iPadOS 18 y macOS Sequoia. Aunque aún no está disponible en versión beta, la compañía se ha comprometido a introducir algunas de estas características pronto, y se espera un lanzamiento público completo para fin de año. Las próximas mejoras incluyen una revisión significativa de Siri, aprovechando las acciones en la aplicación y el contexto personal para ofrecer una experiencia de usuario más intuitiva y receptiva. Se espera que esta revisión esté completamente realizada en la primavera de 2025.

El gobierno federal, bajo el liderazgo del presidente Biden, ha expresado abiertamente la necesidad de que las empresas de inteligencia artificial se ganen la confianza del público. Las directrices de la administración hacen hincapié en proteger a los estadounidenses de posibles fraudes provocados por la IA, promover la equidad y los derechos civiles y garantizar que los sistemas de IA no comprometan la seguridad nacional. Como parte de estos esfuerzos, el Departamento de Comercio desarrollará estándares para la autenticación de contenido y la creación de marcas de agua, etiquetando claramente el contenido generado por IA para evitar información errónea.

La participación de Apple en este esfuerzo colectivo resalta su compromiso con el desarrollo responsable de la IA. Al integrar proveedores de IA externos, comenzando con ChatGPT, en sus sistemas operativos, Apple está ampliando sus capacidades de IA al tiempo que cumple con estrictos estándares de privacidad y seguridad.

Mientras la industria tecnológica navega por las complejidades de la innovación en IA, el cumplimiento de estas directrices por parte de Apple sienta un precedente para otras empresas. La naturaleza voluntaria de estas salvaguardas refleja el reconocimiento por parte de la industria de la necesidad de prácticas responsables de IA. Sin embargo, la ausencia de legislación formal resalta la importancia de una vigilancia continua y medidas proactivas para salvaguardar los intereses públicos en el panorama de la IA en rápida evolución.

Leer más:Solucionar el error HRESULT 0xc80002 .NET Framework 4.0

(a través deBloomberg)