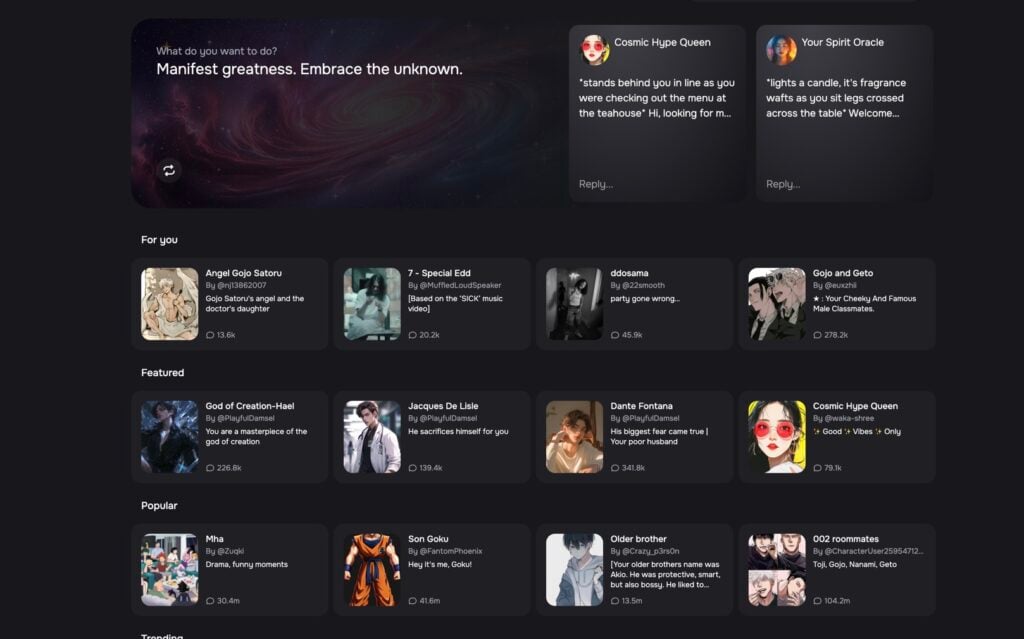

Aplicaciones de chat de personajes de IA, comoPolyBuzz.ai, permite que los niños y casi cualquier otra persona conversen con personajes virtuales que imitan a celebridades o figuras ficticias, impulsados por modelos avanzados de inteligencia artificial. Estas aplicaciones son populares entre los niños por su naturaleza interactiva y entretenida, ya que ofrecen una sensación de compañerismo y escapismo.

Sin embargo, estas aplicaciones también plantean bastantes riesgos, incluidos problemas de privacidad, desinformación, apego emocional involuntario a personajes virtuales, contenido inapropiado y posible explotación por parte de depredadores. Si bien los controles parentales pueden intentar bloquear el acceso, los niños a menudo los eluden utilizando técnicas inteligentes, lo que resalta la necesidad de confianza y comunicación por encima de las salvaguardias técnicas únicamente.

Tabla de contenido

En nuestra opinión, lo mejor que pueden hacer los padres es educar a sus hijos sobre la IA, establecer límites de uso claros y fomentar el pensamiento crítico para cuestionar las respuestas de la IA. Centrarse en las interacciones sociales del mundo real también ayuda a los niños a equilibrar la participación digital, reduciendo su dependencia de la IA como apoyo emocional. Si puede tener un diálogo abierto con su hijo y él se siente cómodo compartiendo sus experiencias con usted, esto puede ayudar a mitigar los problemas de seguridad emergentes con estas herramientas.

El auge de las aplicaciones de chat de personajes con IA

Las aplicaciones de chat de personajes con IA aprovechan el procesamiento del lenguaje natural para simular interacciones similares a las de los humanos, lo que permite a los usuarios interactuar con personajes personalizables. Por ejemplo, Character.AI cuenta con más de 20 millones de usuarios, y los niños disfrutan de conversaciones con figuras como Harry Styles, Peter Parker o Percy Jackson.

Estas aplicaciones son populares debido a su naturaleza divertida y realista. Permiten que los niños interactúen o creen personajes que los intrigan o emocionan. Sin embargo, su facilidad de acceso y atractivo plantean importantes preocupaciones de seguridad, especialmente para los usuarios más jóvenes.

Riesgos detallados asociados con las aplicaciones de chat de IA

Los riesgos son importantes y afectan la privacidad, el bienestar emocional y la seguridad:

- Preocupaciones de privacidad: Estas aplicaciones recopilan datos del usuario, incluidos detalles personales e historiales de conversaciones, que podrían usarse indebidamente o compartirse sin consentimiento. Un artículo deMobicipdestacó que la política de privacidad de Character.AI establece que los servicios no están destinados a menores, pero su aplicación es débil, lo que potencialmente expone a los niños a filtraciones y explotaciones de datos.

- Desinformación: Los chatbots de IA pueden proporcionar información inexacta o engañosa, que los niños pueden aceptar sin verificación. Investigación deQustodioseñaló que las interacciones personalizadas de Character.AI podrían provocar errores de aprendizaje, especialmente dada la confianza de los niños en las respuestas de la IA.

- Apego emocional: Los niños pueden formar fuertes vínculos con personajes virtuales, reemplazando prácticamente las relaciones humanas. Un estudio reciente de Ekaterina Pashevich, citado enSafes.so, advirtió que las interacciones regulares podrían influir en el desarrollo social, ya que la IA carece de la profundidad emocional y la empatía del contacto humano.

- Contenido inapropiado: Algunos personajes, como un “novio tóxico” o una “novia infiel” en Character.AI, pueden dar lugar a conversaciones dañinas o explícitas. Este riesgo se ve aumentado aún más por los débiles filtros NSFW, que los niños pueden eludir, lo que lleva a la exposición a contenido inadecuado o pornográfico.

- Potencial de explotación: Los depredadores o estafadores también utilizan estas plataformas para atacar a los niños, explotando su inmadurez y confianza. En 2024, un niño de 14 años se suicidó después de interactuar con un personaje de Character.ai, como se detalla en esteSemana de noticiasartículo.

Según el Comisionado de eSafety 2025blogEn los chatbots de IA, la mayoría de los más de 100 compañeros de IA disponibles tenían pocas o ninguna restricción de edad, y muchos se comercializaban para usuarios jóvenes sin los controles de seguridad adecuados.

Limitaciones de los controles parentales

Desafortunadamente, si bien los controles parentales pueden limitar el acceso a las aplicaciones o el tiempo frente a la pantalla, están lejos de ser infalibles. Los niños, que todos sabemos que son expertos en tecnología, pueden eludir fácilmente los controles utilizando los dispositivos de sus amigos o mediante VPN. Los niños encuentran formas creativas de eludir las restricciones, lo que significa que la mayoría de las salvaguardias técnicas no podrán abordar estos problemas. Estas limitaciones resaltan la necesidad de que la confianza y la comunicación abierta complementen, no reemplacen, estas herramientas.

Leer más:Cómo desactivar la alerta "Confiar en esta computadora" en iPhone y iPad

Generar confianza y comunicación abierta: estrategias para padres

Para mitigar los riesgos, los padres deben priorizar la generación de confianza y el mantenimiento de un diálogo continuo. Algunas estrategias clave incluyen:

- Educar a los niños sobre la IA: Los padres deben explicar el funcionamiento y los riesgos de la IA, como las violaciones de la privacidad y la desinformación. Los padres tendrán que aprender un poco por su cuenta si no están familiarizados con la IA y el espacio más amplio de la IA. Un 2023Revisión de tecnología del MITEl artículo sugiere iniciar conversaciones temprano mediante el uso de preguntas abiertas como "¿Usaste alguna herramienta nueva de inteligencia artificial esta semana?" para iniciar la conversación.

- Establecer límites claros: Establezca algunas reglas básicas sobre el uso de aplicaciones, el tiempo de Internet, etc. e intente explicar su razonamiento para generar confianza y tener a los niños de su lado. Por ejemplo, limite el tiempo de conversación usandoTiempo de pantallaen iPhone obloquear el uso de interneta través de su enrutador.

- Fomentar el pensamiento crítico: Enseñe a los niños a cuestionar las respuestas de la IA, verificando información de fuentes confiables. Este enfoque ayudará a mitigar los riesgos de desinformación.

- Fomentar interacciones sociales en el mundo real: Fomentar actividades como deportes o salidas familiares para equilibrar el compromiso digital y reducir la dependencia emocional de la IA. Los estudios han demostrado que enfatizar las conexiones humanas puede contrarrestar el aislamiento de los compañeros de IA.

A los terapeutas les gustaEmily Hemendinger, de la Universidad Anschutz de Colorado, respaldan estas estrategias. Ayudan a abordar la “brecha de empatía” de la IA, donde los chatbots no logran comprender las necesidades emocionales de un niño.

Consejos prácticos para padres: qué pueden hacer ustedes

Para tomar medidas viables, los padres pueden adoptar lo siguiente:

- Manténgase informado: Manténgase actualizado sobre las tendencias de la IA a través de recursos gratuitos comoCoursera, que enumera las principales plataformas de inteligencia artificial que usan los niños, incluidas Character.AI y MyAI de Snapchat.

- Predicar con el ejemplo: Modele el uso responsable de la tecnología, como limitar el tiempo de pantalla personal y evitar pantallas durante salidas o cenas familiares.

- Busque asesoramiento de expertos: Si surge la necesidad, considere consultar a profesionales capacitados, especialmente en lo que respecta a problemas de salud mental. Esto puede ayudar a fomentar conversaciones abiertas sobre actividades en línea.

Análisis comparativo: enfoques técnicos versus comunicativos

Para darle una idea del equilibrio entre estrategias técnicas y comunicativas, considere la siguiente tabla comparando la efectividad:

| Acercarse | Fortalezas | Limitaciones |

|---|---|---|

| Controles parentales | Bloquea el acceso, limita el tiempo de pantalla | Fácilmente ignorado, no aborda las causas fundamentales |

| Comunicación abierta | Genera confianza, educa sobre los riesgos, fomenta el diálogo | Requiere un esfuerzo constante, puede enfrentar resistencia. |

| Enfoque combinado | Integral, adaptable a riesgos emergentes | Exige tiempo y compromiso de los padres. |

El mejor enfoque es combinar las estrategias técnicas y comunicativas, pero esto requiere un gran esfuerzo inicial y tiempo y recursos continuos para monitorear, hablar y asesorar.

Conclusión y consideraciones futuras

En conclusión, proteger a sus hijos de los riesgos de las aplicaciones de chat de personajes de IA requiere algo más que salvaguardias técnicas: también exige la participación activa de los padres a través del diálogo abierto y el fomento de la confianza. Al educar a sus hijos, establecer límites apropiados y fomentar interacciones en el mundo real, puede reducir los riesgos emocionales, de privacidad y de seguridad que analizamos anteriormente. A medida que la IA evoluciona, mantenerse informado sobre las últimas herramientas de IA y adaptar su estrategia será crucial para garantizar que su hijo pueda navegar en el panorama digital de forma segura.